M6101六級能效電源IC 集成電路設計的關鍵躍遷

在當今追求高效節能的電子設備市場中,電源管理集成電路的設計至關重要。M6101六級能效電源IC的出現,不僅代表了電源管理技術的一次重大進步,更在集成電路設計領域樹立了新的標桿。

M6101芯片概述

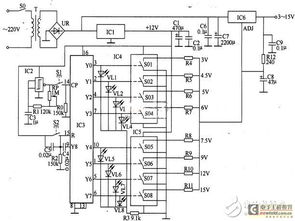

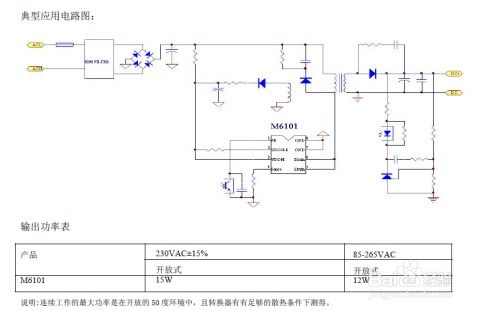

M6101是一款專為滿足嚴格能效標準設計的電源管理芯片,其核心目標是實現從空載到滿載的六級能效轉換效率。與傳統的電源IC相比,它能在更廣泛的負載條件下維持高效率,這對于降低電子設備的待機功耗和運行能耗具有革命性意義。

集成電路設計的核心挑戰與突破

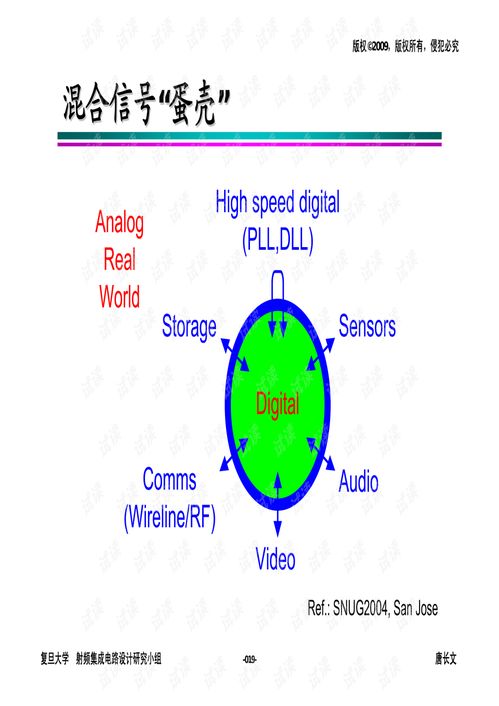

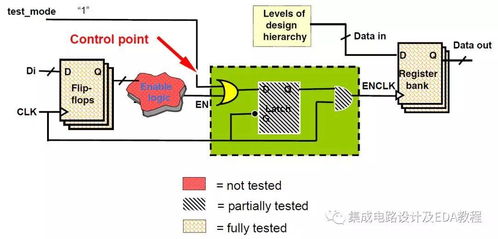

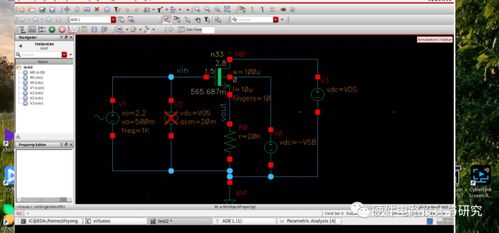

設計一款能達到六級能效的電源IC,面臨多重挑戰。需要在極寬的負載范圍內優化功率轉換效率,這要求設計團隊在電路拓撲、開關頻率控制和同步整流技術上進行深度創新。M6101通過采用先進的多模式控制架構,如跳頻模式、突發模式和省電模式的智能切換,實現了從微安級輕載到安培級重載的高效覆蓋。

芯片的靜態功耗必須降至極低水平。M6101的設計集成了超低功耗的啟動電路和待機管理單元,確保在設備休眠或待機時,芯片自身的能耗微乎其微,從而滿足全球最嚴苛的能效法規要求。

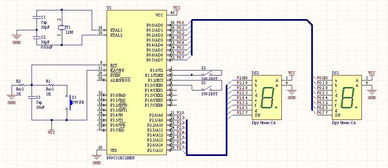

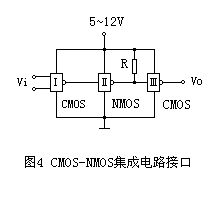

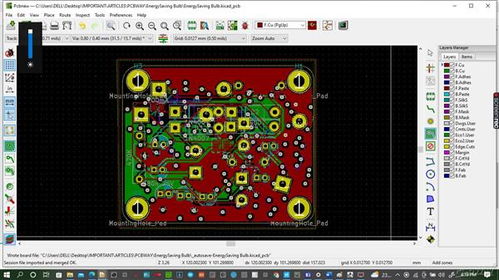

在工藝與集成度方面,M6101采用了高性能的BCD工藝,將高壓功率MOSFET、精密模擬電路和數字控制邏輯高效集成于單一芯片。這種高度集成不僅減小了解決方案的尺寸和外圍元件數量,還提高了系統的可靠性和穩定性。

設計考量與系統優化

成功的電源IC設計遠不止于芯片本身。M6101的設計充分考慮了系統級的應用優化:

- 熱管理:通過優化的封裝設計和內部布局,有效分散熱量,確保芯片在高負載下穩定工作。

- 電磁兼容性:內置的頻率抖動技術和軟開關技術,顯著降低了開關噪聲,簡化了系統通過EMC認證的難度。

- 保護功能:集成了全面的保護電路,如過溫保護、過流保護、過壓保護和欠壓鎖定,為終端設備提供堅固的安全屏障。

應用前景與行業影響

M6101六級能效電源IC的設計,為適配器、充電器、電視、顯示器及各類智能家居設備的電源方案提供了理想選擇。其卓越的能效表現,直接助力終端產品降低碳排放,符合全球綠色可持續發展的趨勢。

從集成電路設計的角度看,M6101的成功標志著電源管理芯片從追求單一性能峰值,轉向在全工況范圍內實現最優綜合性能的新階段。它推動了設計方法論、工藝技術和系統架構的協同創新,為未來更高能效、更智能化的電源解決方案奠定了堅實基礎。

M6101不僅僅是一款高性能的電源IC,更是集成電路設計思想向極致能效與系統集成邁進的一個典范。它的出現,將持續驅動整個電子行業向更節能、更環保的方向發展。

如若轉載,請注明出處:http://www.inhei.cn/product/54.html

更新時間:2026-04-16 16:35:27